La Guerra para destruir Nvidia acaba de empezar: contexto y origen

La explosión de la inteligencia artificial generativa no fue casualidad.

El lanzamiento de ChatGPT demostró que un modelo de lenguaje podía conquistar al público general. OpenAI se adelantó a las grandes tecnológicas arriesgando más en velocidad que en la perfección del producto.

Mientras tanto, el resto de gigantes observaba el fenómeno y calculaba el riesgo reputacional de fallar en público.

Nvidia llevaba años invirtiendo en GPU especializadas para cómputo masivo.Cuando la IA generativa despegó, sus chips ya estaban listos para entrenar modelos enormes.Los centros de datos necesariosn procesar millones de parámetros en paralelo y las GPU superaban claramente a las CPU.

Así, casi cualquier empresa que quisiera competir en IA terminaba llamando a la puerta de Nvidia.

La demanda se disparó y operaron cuellos de botella en el suministro global de chips avanzados. Empresas como Meta anunciaron infraestructuras con cientos de millas de unidades H100 dedicadas a IA generativa. En pocos meses, Nvidia pasó de ser un actor clave del sector gráfico al símbolo bursátil de la revolución IA. Sin embargo, alcanzar la cima es solo la primera parte de la historia.

La Guerra para destruir Nvidia acaba de empezar porque ningún gigante quiere depender eternamente de un solo proveedor. Los costos de las GPU de gama alta son enormes y afectan a márgenes, precios y velocidad de innovación. Además, la geopolítica de semiconductores introduce riesgos de suministro que preocupan a gobiernos y multinacionales.

Por eso, la nueva fase de la carrera se centra en construir alternativas competitivas al dominio de Nvidia.

Nvidia vs Amazon: la nube entra en la batalla de chips de IA

Amazon domina el mercado de computación en la nube con AWS.

Durante años ofreció instancias basadas principalmente en procesadores y GPU de terceros. La ola de IA generativa obligó a la compañía a replantear esa dependencia.

Primero llegaron chips diseñados a medida para tareas específicas, como entrenamiento y despliegue de modelos. La nueva generación Trainium3 promete más rendimiento y mejor eficiencia energética que sus predecesores. Estos chips buscan reducir costes por entrenamiento y por inferencia en aplicaciones masivas.

Amazon no pretende copiar exactamente las GPU de Nvidia.

Su objetivo es ofrecer a los clientes de AWS una plataforma optimizada y profundamente integrada con sus servicios. Con ello, puede ajustar precios, controlar inventario y diseñar arquitecturas adaptadas a cargas reales de trabajo.

Además, la compatibilidad anunciada con tecnologías de interconexión de alta velocidad amplía las posibilidades de escalamiento.

Permite conectar múltiples nodos especializados en IA dentro del mismo centro de datos. Esto resulta crítico cuando los modelos alcanzan billones de parámetros y exigen enormes clústeres de cómputo.

La estrategia también tiene una dimensión competitiva clara.

Si los clientes pueden entrenar modelos avanzados usando chips propios de Amazon, el poder de negociación cambia.

Nvidia sigue siendo un socio importante, pero ya no es la única pieza imprescindible del rompecabezas.

En este escenario, La Guerra para destruir Nvidia acaba de empezar a materializarse en cada contrato de nube. Las decisiones de arquitectos y directores de tecnología determinarán qué plataformas liderarán la próxima década.

Nvidia vs Google y la apuesta por TPU y Gemini

Google lleva años invirtiendo en sus TPU, unidades de procesamiento tensores enfocadas a IA.Al principio, estas piezas estaban reservadas casi exclusivamente a los productos internos de la compañía. Con el auge de la IA generativa y de Gemini, la estrategia cambió gradualmente.

Google empezó a posicionar sus chips como una alternativa seria para entrenamiento y despliegue de grandes modelos.Ofrecer TPU en su nube permite diferenciarse de la competencia y optimizar el rendimiento de sus propios servicios. Además, reduzca la exposición a cambios de precios o limitaciones de suministro de proveedores externos.

La compañía del buscador ve en el hardware un eje clave de ventaja competitiva.Controlar desde el diseño del chip hasta el modelo de IA crea sinergias difíciles de replicar. Permite ajustar arquitecturas, memorias y redes de interconexión a las necesidades reales de Gemini.

Al mismo tiempo, otras empresas exploran acuerdos para usar estos chips de Google en sus propios proyectos. Rumores de inversiones multimillonarias muestran el interés del mercado por escapar al monocultivo de GPU. Cada contrato potencial representa menos dependencia directa de Nvidia en infraestructuras críticas.

Este movimiento presiona a todo el ecosistema. Si Google demuestra que su pila hardware‑software escala mejor para ciertas cargas, otras seguirán el ejemplo. La Guerra para destruir Nvidia acaba de empezar también en laboratorios de investigación y startups de IA avanzada.

GPU Nvidia frente a nuevos aceleradores de IA

Aunque la competencia crece, las GPU Nvidia siguen siendo referencia en rendimiento y ecosistema software. La arquitectura CUDA y sus bibliotecas permiten a investigadores y empresas desarrollar soluciones con relativa rapidez. Sin embargo, el éxito pasado no garantiza el liderazgo futuro en un mercado tan dinámico.

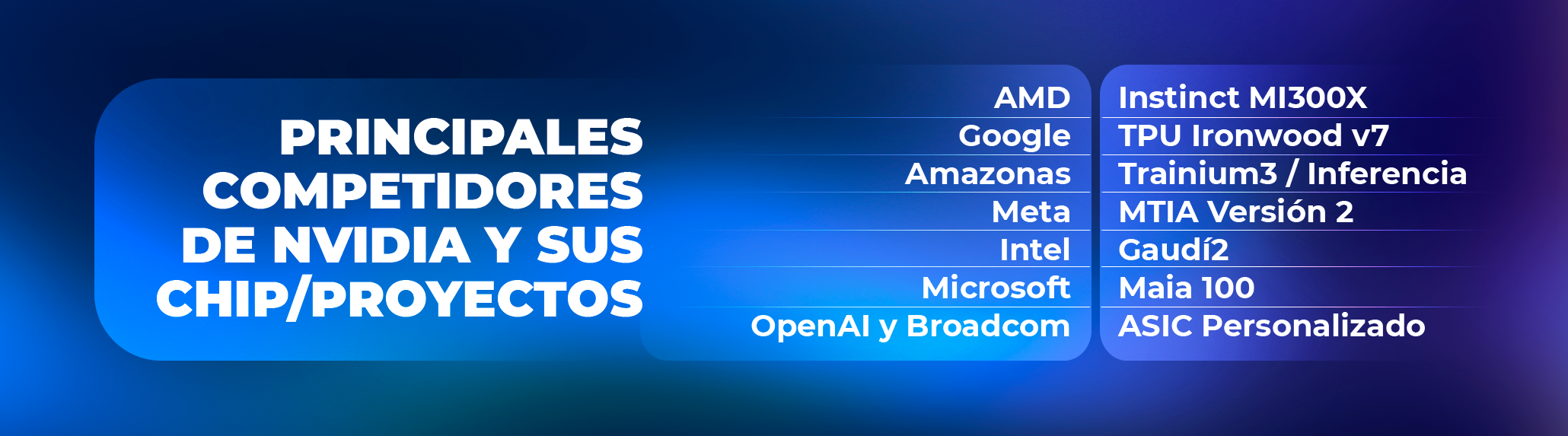

Meta trabaja en aceleradores propios para entrenamiento e inferencia de modelos gigantes. Su objetivo es equilibrar costes, consumo energético y control estratégico sobre su infraestructura. OpenAI, por su parte, explora alianzas para diseñar hardware adaptado a sus necesidades específicas.

En Asia, compañías como Huawei impulsan chips avanzados para IA pese a las restricciones comerciales. Estos desarrollos persiguen cubrir el espacio que dejan las limitaciones de exportación de tecnología estadounidense. El resultado es un mapa de proveedores de hardware cada vez más fragmentado y competitivo.

Para las empresas usuarias, esta diversidad plantea oportunidades y desafíos.Por un lado, aumenta la oferta y puede reducir precios o mejorar condiciones contractuales. Por otro, obliga a planificar arquitecturas más flexibles y evitar dependencias tecnológicas excesivas.

Los gobiernos también observan la situación con atención.

El acceso a cómputo de alto rendimiento se considera ya un asunto de soberanía digital. Las políticas industriales buscan apoyar a los fabricantes locales y garantizar cadenas de suministro seguras.

En este contexto, la posición de Nvidia dependerá de su capacidad para innovar más allá del hardware. El valor añadido llegará de plataformas completas que integran chips, redes, software y servicios en la nube.

Quien logrará ofrecer la combinación más eficiente y abierta marcará el rumbo de la próxima década de IA.

La Guerra para destruir Nvidia acaba de empezar y su desenlace redefinirá quién controlará el poder del cómputo y la Inteligencia Artificial Generativa.

Preguntas frecuentes

¿Por qué Nvidia domina actualmente el mercado de GPU para IA?

Nvidia domina el mercado de GPU para IA debido a su combinación única de alto rendimiento, eficiencia energética y ecosistema de software. Sus GPUs están optimizadas para cálculos paralelos masivos, esenciales en entrenamiento de modelos de inteligencia artificial, y frameworks como CUDA y cuDNN facilitan la integración y adopción de sus productos por desarrolladores e investigadores.

¿Qué empresas están tratando de competir con Nvidia?

Empresas como AMD, Intel, Amazon y Google están desarrollando alternativas a las GPUs de Nvidia. AMD e Intel ofrecen GPUs y aceleradores de propósito específico, mientras que Amazon ha creado los chips Graviton y Train y Google los Tensor Processing Units (TPU), todos diseñados para optimizar cargas de trabajo de inteligencia artificial y reducir la dependencia de Nvidia.

¿Cómo responden Amazon y Google con sus propios chips?

Amazon y Google están desarrollando chips propios para incrementar su independencia tecnológica. Amazon utiliza Graviton para eficiencia en servidores y Train para entrenamiento de IA, mientras Google implementa TPU optimizadas para aprendizaje profundo. Estos chips buscan mejorar rendimiento, reducir costos y ofrecer mayor control sobre la infraestructura de IA.

¿Seguirán los grandes centros de datos dependiendo de Nvidia?

Aunque Nvidia sigue siendo dominante, los grandes centros de datos están explorando alternativas para diversificar sus proveedores y optimizar costos. La introducción de chips propios por Amazon y Google y la competencia de otros fabricantes permiten que la dependencia de Nvidia disminuya gradualmente, aunque su ecosistema y soporte siguen siendo muy valorados.

¿Qué impacto tendrá esta guerra tecnológica en los precios de hardware?

La competencia impulsada por esta guerra tecnológica probablemente estabilizará o reducirá los precios de GPUs y aceleradores de IA. Más opciones de hardware significan que startups, centros de investigación y empresas medianas podrán acceder a soluciones más económicas, sin depender exclusivamente de Nvidia, democratizando así el acceso a la inteligencia artificial.

¿Cómo afectará la innovación en inteligencia artificial?

La competencia intensifica la innovación tecnológica. Nuevas arquitecturas, mejoras en eficiencia energética, integración de memoria de alta velocidad y optimización de conectividad entre unidades de procesamiento permiten entrenar modelos más grandes y complejos, acelerando el desarrollo de aplicaciones avanzadas en visión por computadora, procesamiento de lenguaje natural y robótica.

¿Qué ventajas tienen los chips propios de Amazon y Google?

Los chips propios permiten mayor autonomía tecnológica y optimización específica de cargas de trabajo. Amazon y Google pueden controlar el diseño, mejorar eficiencia, reducir costos operativos y adaptar el hardware a sus necesidades exactas, lo que les da una ventaja frente a depender de GPUs de terceros y les permite ofrecer servicios más competitivos a sus clientes.

¿Existen riesgos al diversificar proveedores de GPU?

Sí, diversificar proveedores implica desafíos como compatibilidad de software, adaptación de modelos existentes y capacitación de ingenieros. La fragmentación puede generar incompatibilidades y retrasos en proyectos, lo que obliga a equilibrar la independencia tecnológica con la eficiencia y estabilidad en centros de datos.

¿Cómo cambiará la disponibilidad de GPUs para investigadores y startups?

La entrada de chips alternativos ampliará la disponibilidad de hardware potente y más económico para investigadores y startups. Esto significa mayor acceso a entrenamiento de modelos complejos sin depender exclusivamente de Nvidia, fomentando la investigación y el desarrollo de nuevas aplicaciones de inteligencia artificial a nivel global.

¿Qué significa esta guerra para el futuro de la inteligencia artificial?

Esta guerra tecnológica acelerará la diversificación, la innovación y la eficiencia en hardware de IA. Más competencia generará mejores chips, reducción de costos y mayor acceso a tecnología avanzada, lo que permitirá que la inteligencia artificial se integre más rápido y de forma más accesible en distintos sectores, desde la industria hasta la investigación académica.

Déjanos tu comentario

Tu opinión nos ayuda a esforzarnos más para hacer programas con altos estándares de calidad que te ayuden a mejorar profesionalmente.