¿Cómo afecta la alucinación algorítmica a las Fintechs?

La alucinación algorítmica es un fenómeno profundamente perjudicial que impacta directamente en la confianza que las fintechs depositan en sus sistemas automatizados de toma de decisiones. La mayor promesa de las fintechs es la optimización de procesos mediante el uso de la inteligencia artificial, lo que permite una evaluación más rápida y precisa de los solicitantes de crédito, sin la necesidad de intervención humana directa. Sin embargo, cuando los modelos de IA comienzan a “alucinar”, las consecuencias pueden ser devastadoras.

Si bien la IA ofrece eficiencia y velocidad en el análisis de datos, su falta de contexto y la incapacidad para detectar errores sutiles en los datos puede resultar en decisiones desastrosas. En el afán por automatizar todos los procesos, muchas startups no consideran la necesidad de una auditoría humana constante. Esto puede dar lugar a decisiones erróneas que no solo representan una pérdida financiera directa, sino que también dañan la reputación de la empresa y ponen en riesgo su sostenibilidad.

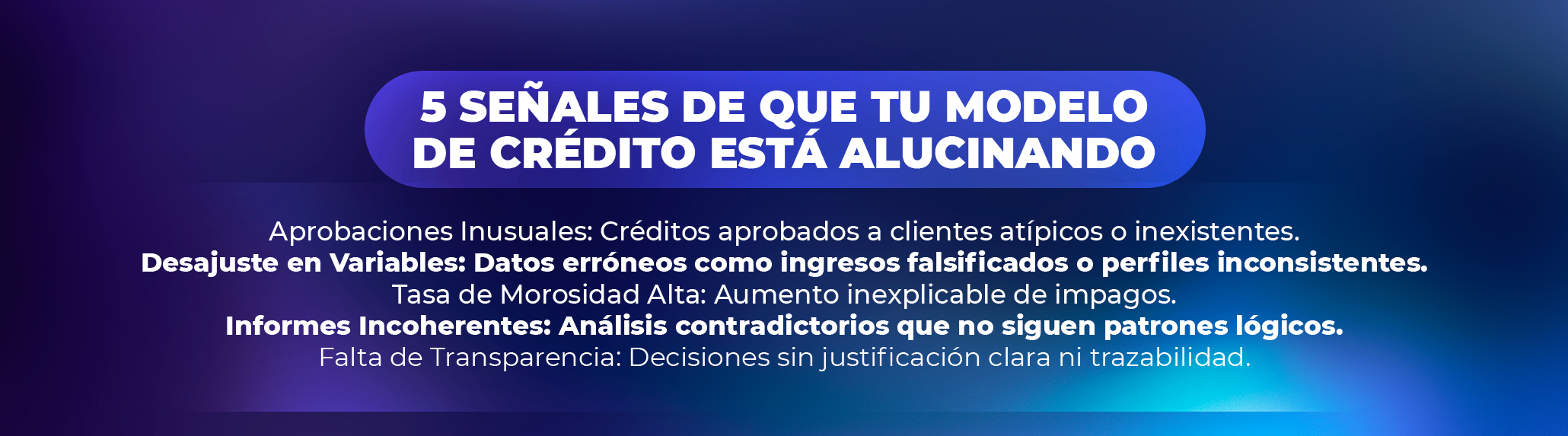

5 señales de que tu modelo de crédito está alucinando

Identificar si tu modelo de crédito está “alucinando” es vital para prevenir pérdidas financieras y daños a la reputación de tu fintech. Aquí te dejamos un checklist con las principales señales:

-

Aprobaciones fuera de lo común: Si tu modelo de IA está aprobando préstamos a perfiles de clientes que nunca antes habías considerado, podría ser un indicio de que los datos que el sistema está utilizando no son confiables.

-

Datos inconsistentes o incompletos: La IA puede generar patrones basados en datos incompletos, llevando a aprobaciones erróneas. Revisa las fuentes de los datos y las inconsistencias que podrían estar influyendo en las decisiones.

-

Frecuencia de impagos o morosidad elevada: Un aumento inesperado en los impagos o morosidad podría estar relacionado con créditos otorgados a clientes que no deberían haber calificado.

-

Discrepancias en las variables del cliente: Si el sistema empieza a aprobar préstamos basados en variables irrelevantes o inventadas, como un “ingreso promedio” que no concuerda con otros datos, es una señal de alerta.

-

Sistemas sin auditores humanos involucrados: La falta de una verificación humana periódica sobre las decisiones automáticas de IA es un riesgo claro. Un modelo sin supervisión puede llevar a un alto porcentaje de "alucinaciones".

Cómo implementar un comité de verificación humana sin ralentizar procesos

La solución no es eliminar la IA, sino integrar un comité de verificación humana que revise las decisiones más críticas sin afectar la velocidad de los procesos. A continuación te dejamos algunas estrategias para implementar un comité de verificación humana efectivo algunos consejos para implementarlo de manera eficiente:

-

Automatización de la revisión preliminar:Utiliza IA para identificar los casos más complejos o sospechosos, y que un equipo humano se enfoque solo en esos.

-

Establecimiento de umbrales de riesgo: Define criterios claros para cuando es necesario la intervención humana, como casos con una alta probabilidad de error o inconsistencias en los datos.

-

Auditorías periódicas: Establece un sistema de auditoría que revise periódicamente las decisiones tomadas por la IA, para ajustar modelos y evitar errores futuros.

-

Entrenamiento continuo para el equipo humano: El equipo de verificación debe estar bien capacitado para identificar los patrones que podrían indicar que la IA está alucinando, y cómo actuar de forma rápida y eficiente.

-

Mejora continua del modelo de IA: Utiliza los datos de las auditorías humanas para mejorar continuamente los algoritmos y minimizar el riesgo de alucinaciones.

Preguntas frecuentes

¿Cuáles son las principales críticas a las FinTech?

Las FinTech suelen ser criticadas por la falta de transparencia en sus algoritmos, ya que muchas decisiones financieras se toman mediante modelos automatizados difíciles de entender para los usuarios. También existen preocupaciones sobre la privacidad de los datos, el uso intensivo de información personal y la posibilidad de exclusión financiera de personas con bajo historial digital. Además, se cuestiona la rapidez con la que crecen algunas empresas sin una supervisión regulatoria sólida.

¿Por qué se considera que los algoritmos de las FinTech pueden ser un riesgo?

Los algoritmos pueden convertirse en un riesgo cuando funcionan como una “caja negra”, es decir, cuando no se puede explicar claramente cómo llegan a sus decisiones. Esto puede provocar errores, sesgos o incluso discriminación involuntaria. En algunos casos, estos sistemas han aprobado créditos a perfiles inexistentes o mal evaluados, lo que genera pérdidas financieras.

¿Qué tecnología emergente se utiliza para identificar patrones de riesgo en transacciones financieras?

La tecnología más utilizada es la inteligencia artificial combinada con el aprendizaje automático. Estas herramientas analizan grandes volúmenes de datos en tiempo real y detectan patrones anómalos que pueden indicar fraudes o comportamientos de riesgo. Con el tiempo, estos sistemas aprenden y mejoran su capacidad de detección.

¿Cómo ayuda el machine learning a prevenir fraudes financieros?

El machine learning permite comparar transacciones actuales con comportamientos históricos considerados normales. Cuando detecta desviaciones significativas, el sistema puede alertar, bloquear la operación o solicitar una verificación adicional. Esto hace posible prevenir fraudes de forma más rápida y precisa que los métodos tradicionales.

¿Qué papel juega el Big Data en las FinTech?

El Big Data permite analizar enormes cantidades de información financiera y de comportamiento de los usuarios. Gracias a este análisis, las FinTech pueden evaluar riesgos crediticios, personalizar servicios y detectar actividades sospechosas. Sin embargo, su uso también genera debates sobre la protección de datos y la privacidad.

¿Cuál fue el principal problema con la autorregulación de las empresas FinTech?

El principal problema fue el conflicto de intereses, ya que las propias empresas definían y aplicaban sus normas sin una supervisión externa fuerte. Esto provocó estándares inconsistentes, controles insuficientes y, en algunos casos, prácticas de riesgo que afectaron a consumidores y al sistema financiero.

¿Por qué la autorregulación no fue suficiente en el sector FinTech?

La autorregulación no fue suficiente porque no garantizaba una protección homogénea para los usuarios. Cada empresa establecía sus propias reglas, lo que generó un entorno desigual y difícil de supervisar. Además, la ausencia de sanciones claras redujo la responsabilidad ante errores graves.

¿Qué es la tecnología financiera FinTech?

La tecnología financiera FinTech es el conjunto de innovaciones tecnológicas aplicadas a los servicios financieros para hacerlos más eficientes, rápidos y accesibles. Incluye soluciones digitales para pagos, créditos, inversiones, seguros y gestión financiera, utilizando tecnologías como inteligencia artificial, blockchain y plataformas móviles.

¿En qué se diferencian las FinTech de los bancos tradicionales?

Las FinTech se diferencian por su enfoque digital, su mayor agilidad y su orientación a la experiencia del usuario. A diferencia de los bancos tradicionales, suelen operar sin sucursales físicas y con procesos automatizados, lo que reduce costos y tiempos. Sin embargo, también enfrentan mayores desafíos regulatorios.

¿Cuál es el mayor desafío futuro para las FinTech?

El mayor desafío será equilibrar la innovación tecnológica con la seguridad, la transparencia y una regulación adecuada. Las FinTech deberán demostrar que sus modelos algorítmicos son justos, explicables y seguros, al mismo tiempo que mantienen la confianza de los usuarios y de los reguladores.

Déjanos tu comentario

Tu opinión nos ayuda a esforzarnos más para hacer programas con altos estándares de calidad que te ayuden a mejorar profesionalmente.