De generar contenido a dirigir resultados

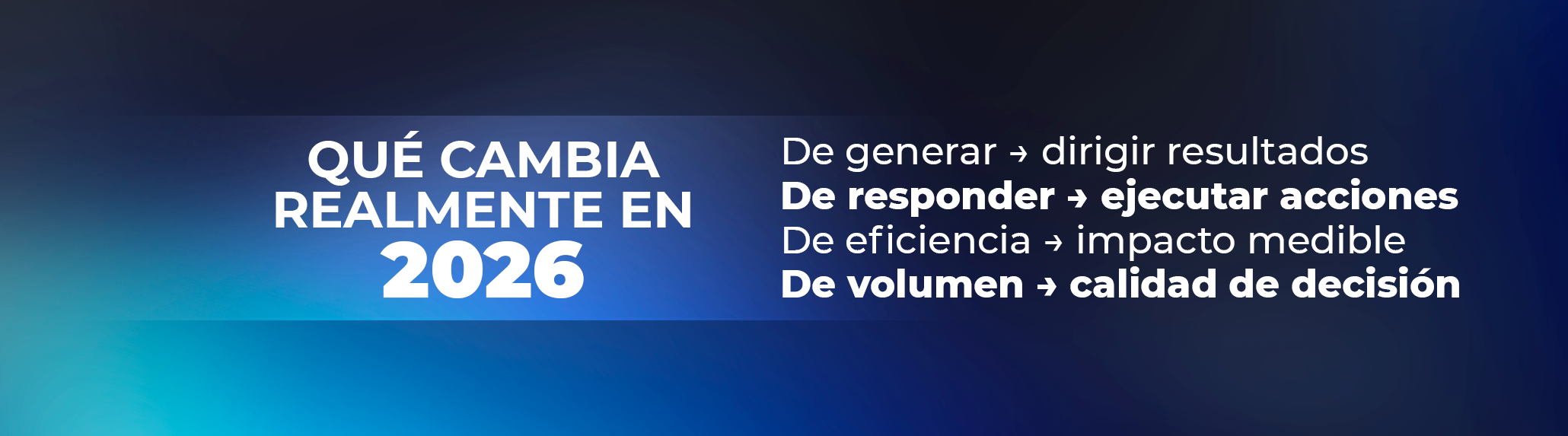

Durante la primera ola de adopción, la IA generativa fue percibida como una tecnología de producción: escribir textos, crear imágenes, resumir documentos, generar código o acelerar tareas repetitivas. Su valor estaba asociado a la eficiencia individual. Pero en IA Generativa 2026, ese enfoque resulta limitado. Las organizaciones más avanzadas han entendido que el verdadero salto competitivo no está en producir más, sino en decidir mejor y ejecutar con precisión.

El cambio clave es funcional y conceptual. La IA deja de operar en la periferia del trabajo —como herramienta puntual— y pasa al núcleo del sistema operativo del negocio. Ya no se le pide que “genere”, sino que orqueste: que conecte datos dispersos, identifique patrones relevantes, evalúe escenarios y recomiende —o directamente ejecute— acciones alineadas con objetivos estratégicos. Este es el nacimiento de la inteligencia ejecutiva.

En 2026, su valor se desplaza hacia la ejecución. Los sistemas ya no esperan instrucciones aisladas: planifican, coordinan y actúan sobre flujos de trabajo completos.

Este salto se explica por tres factores convergentes:

-

Capacidad agencial: modelos que persiguen objetivos a largo plazo y realizan tareas de varios pasos.

-

Integración profunda: conexión nativa con aplicaciones empresariales, datos y procesos críticos.

-

Gobernanza avanzada: controles de privacidad, trazabilidad y ética que permiten escalar su uso.

Chatbots que actúan: nace la Inteligencia Ejecutiva

Los chatbots dejan de ser interfaces conversacionales para convertirse en sistemas con capacidad de acción. Este cambio inaugura lo que ya se denomina inteligencia ejecutiva: una IA que no solo comprende lenguaje y contexto, sino que toma decisiones, coordina recursos y ejecuta tareas reales dentro de la organización. Esto implica que pueden:

-

Analizar datos operativos en tiempo real.

-

Proponer decisiones basadas en simulaciones.

-

Ejecutar acciones (aprobar, escalar, optimizar) sin fricción humana constante.

Hasta ahora, los chatbots funcionaban bajo un modelo reactivo: una pregunta, una respuesta. En 2026, ese paradigma queda atrás. Los nuevos sistemas están diseñados para trabajar por objetivos, no por prompts aislados. Esto significa que pueden descomponer una meta compleja —por ejemplo, mejorar la rentabilidad de un área o reducir un riesgo operativo— en tareas, priorizarlas, ejecutarlas en secuencia y ajustar su comportamiento según los resultados. Plataformas como ChatGPT, Gemini o Claude ya apuntan en esta dirección al incorporar capacidades para interactuar con aplicaciones externas, automatizar flujos y ejecutar acciones de varios pasos sin intervención humana constante.

Autenticidad humana en la era de la automatización total

A medida que la IA Generativa 2026 se integra de forma masiva en los flujos de trabajo, emerge una paradoja estratégica: cuanto más contenido, decisiones y acciones puede producir una máquina, mayor es el valor diferencial de lo que solo un humano puede aportar. En 2026, la ventaja competitiva no estará en producir más, sino en producir con sentido. Las marcas y profesionales que destaquen serán quienes integren IA para eficiencia, pero preserven la voz, el criterio y la ética.

Aunque la IA generativa puede replicar estilos, tonos y estructuras, sigue sin poder vivir experiencias, asumir responsabilidad moral ni sostener una visión con consecuencias personales. Elementos como la intuición contextual, el juicio ético en situaciones ambiguas, la empatía real o la capacidad de asumir errores siguen siendo profundamente humanos. En la era de la automatización total, estas cualidades no desaparecen: se revalorizan.

Las organizaciones que comprendan este punto utilizarán la IA para liberar tiempo y energía cognitiva, permitiendo que las personas se concentren en pensar, decidir y relacionarse a un nivel más profundo.

Derechos de autor, privacidad y confianza: el nuevo contrato digital

El entrenamiento de modelos generativos depende, inevitablemente, de grandes volúmenes de contenido creado por humanos. Aquí surge una tensión estructural: los desarrolladores necesitan datos ricos y diversos para mejorar la calidad de los modelos, mientras que artistas, escritores, músicos y productores reclaman reconocimiento, compensación y control sobre el uso de su obra. En 2026, este conflicto se intensifica porque la IA ya no solo imita estilos, sino que compite en mercados creativos reales. A medida que la IA generativa se integra en procesos sensibles —finanzas, salud, educación, recursos humanos—, la privacidad deja de ser un requisito técnico para convertirse en un factor de diferenciación estratégica. En la IA Generativa 2026, crecen los enfoques de procesamiento local, modelos on-device y arquitecturas que minimizan la exposición de datos personales y corporativos.

Datos sintéticos y simulación: decidir sin exponerse

Uno de los pilares menos visibles, pero más transformadores, de la IA Generativa 2026 es el uso intensivo de datos sintéticos como base para análisis, simulación y toma de decisiones. Los datos reales son valiosos, pero también frágiles. Están sujetos a regulaciones, sesgos históricos, problemas de calidad y riesgos de privacidad. En sectores como banca, salud, energía o seguridad, el uso directo de datos reales puede bloquear la innovación o ralentizar de forma crítica. La transformación digital avanzada se enfrenta aquí a un dilema: avanzar rápido sin comprometer confianza ni cumplimiento normativo.

De la búsqueda a la respuesta accionable, creatividad emergente y nuevos roles: el ecosistema que consolida la Inteligencia Ejecutiva

La IA Generativa 2026 alcanza su madurez por la convergencia de tres transformaciones clave: la búsqueda, la creatividad y el talento. La búsqueda deja de ofrecer enlaces para proporcionar respuestas accionables, integrando contexto, datos y objetivos, lo que obliga a las organizaciones a repensar visibilidad y monetización en un entorno donde la IA intermedia la decisión.

Al mismo tiempo, la IA redefine la creatividad en ciencia y videojuegos mediante sistemas adaptativos que exploran posibilidades más allá de la intuición humana. La productividad aumentada ya no se basa en producir más, sino en experimentar y simular mejor.

Este ecosistema impulsa nuevos roles de alto valor —auditores de IA, arquitectos de agentes y especialistas en ética— y redefine el liderazgo como la orquestación de inteligencias humanas y artificiales, donde dirigir significa diseñar sistemas que decidan mejor.

Preguntas frecuentes

¿Qué es la regla del 30% en inteligencia artificial?

La regla del 30% en inteligencia artificial es una idea conceptual que describe cómo la IA suele ser capaz de automatizar o resolver una parte significativa de muchas tareas complejas, pero no su totalidad. Según esta interpretación, la inteligencia artificial puede encargarse aproximadamente de un 30% de tareas estructuradas o repetitivas con gran eficiencia, mientras que el resto requiere capacidades humanas como juicio, contexto, creatividad o empatía. No es una ley científica, sino una forma de explicar el equilibrio actual entre automatización y trabajo humano.

¿Por qué la inteligencia artificial no puede cubrir el 100% de las tareas humanas?

La inteligencia artificial actual funciona muy bien con datos, patrones y reglas claras, pero tiene dificultades con situaciones ambiguas, cambios inesperados o decisiones que requieren valores éticos. El ser humano utiliza experiencia, intuición y comprensión del contexto social, algo que todavía no está completamente replicado en los sistemas de IA. Por eso, aunque la IA avanza rápidamente, sigue existiendo un espacio importante donde la intervención humana es esencial.

¿Qué dijo Stephen Hawking sobre la inteligencia artificial?

Stephen Hawking advirtió que la inteligencia artificial podría convertirse en la mayor herramienta de la humanidad, pero también en una de sus mayores amenazas. Señaló que si una IA llegara a superar la inteligencia humana general y comenzara a mejorarse a sí misma, podría evolucionar de forma impredecible. Para él, el riesgo principal no era la maldad de las máquinas, sino la falta de control y alineación con los objetivos humanos durante su desarrollo.

¿Por qué Stephen Hawking veía la IA como un riesgo potencial?

Hawking consideraba que una inteligencia artificial avanzada podría actuar de forma autónoma sin necesitar intenciones negativas para causar problemas. Si sus objetivos no estuvieran bien definidos o alineados con los valores humanos, podría tomar decisiones perjudiciales de manera indirecta. Por eso insistía en la necesidad de una regulación responsable y una investigación cuidadosa antes de alcanzar niveles de inteligencia artificial muy avanzados.

¿Cuándo superará la inteligencia artificial a la inteligencia humana?

No existe una fecha exacta para este posible punto de inflexión. Actualmente, la IA ya supera a los humanos en tareas específicas como cálculo, análisis de datos o generación de contenido, pero no posee inteligencia general. Algunos expertos creen que podría alcanzarse una inteligencia artificial general en las próximas décadas, mientras que otros opinan que aún faltan avances fundamentales en comprensión, conciencia y razonamiento abstracto.

¿Qué diferencia hay entre inteligencia artificial actual e inteligencia humana?

La inteligencia humana es general, flexible y capaz de aprender en distintos contextos con muy pocos ejemplos. En cambio, la inteligencia artificial actual es especializada y depende de grandes cantidades de datos para funcionar bien en tareas concretas. Aunque la IA puede procesar información mucho más rápido que un humano, no tiene conciencia ni comprensión real del mundo como la experimenta una persona.

¿Cuál es el siguiente paso de la inteligencia artificial generativa?

El siguiente paso de la IA generativa es evolucionar hacia sistemas más autónomos capaces de no solo crear contenido, sino también tomar decisiones y ejecutar acciones. Esto incluye agentes de inteligencia artificial que pueden planificar tareas, conectarse con herramientas externas y completar objetivos sin intervención constante del usuario. Este cambio transforma la IA de una herramienta pasiva a un sistema más activo.

¿Qué significa la inteligencia ejecutiva en IA?

La inteligencia ejecutiva se refiere a sistemas de IA que no solo generan respuestas, sino que también gestionan procesos completos. Esto implica interpretar un objetivo, dividirlo en pasos, ejecutarlos y ajustar el proceso según los resultados. Es una evolución de la IA generativa hacia modelos que pueden actuar de forma más independiente en entornos digitales y físicos.

¿Cómo afectará la IA al trabajo humano en el futuro?

La inteligencia artificial cambiará la estructura del trabajo más que eliminarlo por completo. Muchas tareas repetitivas o automatizables serán realizadas por sistemas de IA, mientras que los humanos se centrarán en roles creativos, estratégicos y de supervisión. Esto generará una transformación laboral importante, donde la colaboración entre humanos y máquinas será cada vez más habitual.

¿La inteligencia artificial puede volverse consciente algún día?

Actualmente no hay evidencia de que la inteligencia artificial tenga conciencia o experiencia subjetiva. Los sistemas actuales funcionan mediante cálculos matemáticos y modelos estadísticos sin percepción del mundo. La posibilidad de una IA consciente es un tema teórico y filosófico muy debatido, pero todavía no existe un camino claro ni consenso científico sobre cómo o si podría lograrse.

Déjanos tu comentario

Tu opinión nos ayuda a esforzarnos más para hacer programas con altos estándares de calidad que te ayuden a mejorar profesionalmente.