Por qué tu IA está "inventando" realidades

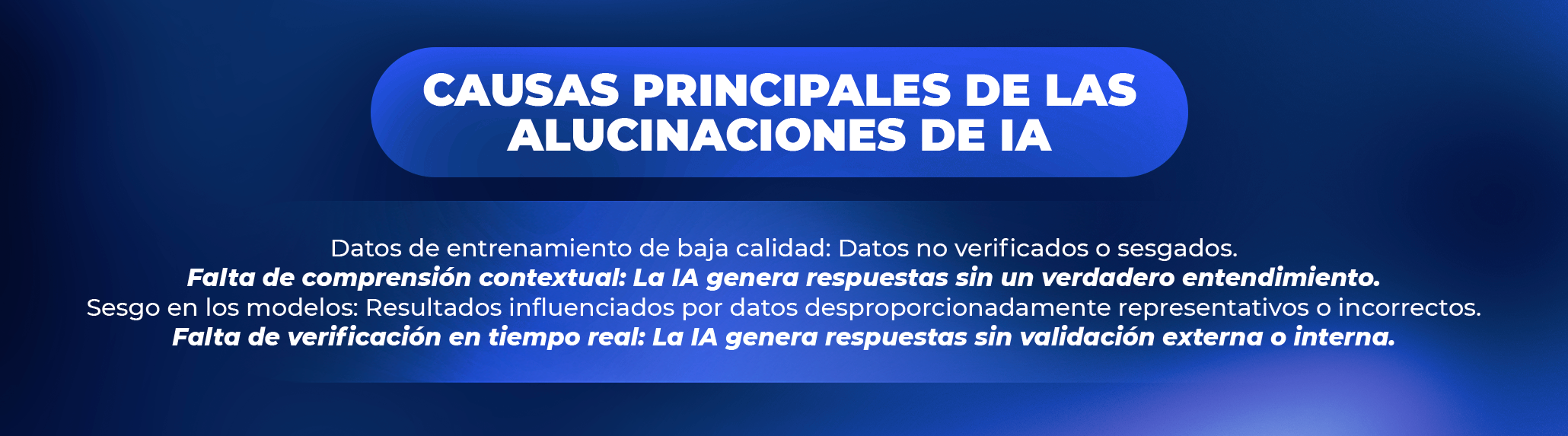

Las alucinaciones de IA son un fenómeno que tiene raíces profundas en la propia naturaleza de cómo funcionan los modelos de inteligencia artificial. Para entender por qué tu IA está "inventando" realidades, es fundamental conocer cómo se entrenan estos sistemas y cómo procesan la información. Los modelos de IA, como los basados en aprendizaje automático (machine learning) y aprendizaje profundo (deep learning), se entrenan utilizando grandes volúmenes de datos que son procesados para detectar patrones y generar respuestas. Los modelos de IA no "entienden" el contenido de los datos de la misma manera que lo haría un ser humano; simplemente buscan correlaciones entre los datos de entrada y las respuestas anteriores que se les han proporcionado.

Este fenómeno es especialmente común en modelos de lenguaje como GPT-3 o GPT-4, que están entrenados con textos de internet, libros, investigaciones y otros contenidos generados por humanos. Aunque estos modelos han sido diseñados para predecir la siguiente palabra o frase en una secuencia dada, en ocasiones, esta predicción puede ir más allá de los datos verificables y crear "hechos" que no existen, simplemente porque se ajustan al contexto o a patrones previos. La IA, entonces, no tiene un mecanismo intrínseco para discernir la verdad de la falsedad. Los datos utilizados para entrenar a estas inteligencias artificiales provienen de una variedad de fuentes, muchas veces sin ningún tipo de filtrado o verificación exhaustiva. Si bien la mayoría de los datos en la web son valiosos, también están llenos de información errónea, sesgada o incompleta. Los algoritmos de IA no tienen la capacidad de discernir entre fuentes confiables y no confiables; simplemente procesan todo como datos de igual valor.

Estos "fallos" en la veracidad de la IA pueden tener un impacto devastador en la reputación de una empresa, por lo que es crucial que los líderes empresariales implementen mecanismos de control adecuados para evitar que estas "realidades inventadas" lleguen a sus clientes o empleados.

Cómo establecer firewalls de veracidad en la empresa

En un entorno digital cada vez más automatizado y dependiente de la inteligencia artificial (IA), el riesgo de alucinaciones de IA —es decir, la generación de información errónea o ficticia por parte de los sistemas— está presente en muchas áreas clave de la operación empresarial. Para mitigar este riesgo, las empresas deben implementar lo que podríamos denominar firewalls de veracidad: un conjunto de controles, procedimientos y tecnologías que garanticen que la información procesada y generada por los sistemas de IA sea precisa, verificable y alineada con los estándares éticos y de calidad de la organización.

Aquí hay algunas estrategias para implementar estos firewalls:

-

Validación externa de datos: Los datos utilizados por la IA deben ser validados por fuentes confiables antes de ser procesados. La implementación de servicios de verificación de datos, como bases de datos verificadas o algoritmos de comparación cruzada, puede ayudar a garantizar que la información generada sea precisa.

-

Entrenamiento supervisado: Los modelos de IA deben ser entrenados con datos de alta calidad y en un entorno supervisado para reducir el riesgo de aprender patrones incorrectos o sesgados.

-

Filtros de calidad en tiempo real: Integrar filtros que detecten anomalías o inconsistencias en los resultados generados por IA. Estos filtros pueden estar basados en inteligencia humana, donde los operadores de la IA revisan y validan las respuestas antes de que se utilicen en escenarios críticos.

Auditoría de outputs: El nuevo rol de la dirección

A medida que la IA se integra más profundamente en los procesos de negocio, la capacidad de supervisar, evaluar y corregir los resultados generados por estos sistemas se ha convertido en una responsabilidad clave para los CEO y otros líderes empresariales. Esta responsabilidad no es solo una cuestión de control de calidad, sino una medida esencial para proteger la reputación y la integridad de la empresa, garantizar la confianza del cliente y prevenir los riesgos legales y éticos derivados de la desinformación generada por IA. Para llevar a cabo una auditoría efectiva, los líderes deben considerar los siguientes aspectos:

-

Monitoreo continuo: Las IAs no son estáticas. A medida que evolucionan y aprenden, es fundamental que los resultados generados sean evaluados de manera constante. Esto no solo implica la revisión de respuestas individuales, sino también la evaluación del desempeño global de los sistemas de IA.

-

Establecimiento de métricas de confianza: Crear un sistema de medición de la "confianza" de la IA. Las métricas pueden incluir la precisión de los datos generados, la consistencia con las fuentes verificadas y la validación por expertos humanos.

-

Capacitación de equipos: Formar a los equipos que supervisan la IA en la empresa para que comprendan los riesgos asociados con las alucinaciones y puedan detectar rápidamente cualquier desviación o error en los resultados generados.

Preguntas frecuentes

¿Qué son las alucinaciones de IA?

Las alucinaciones de IA son errores en los que un modelo de inteligencia artificial genera información falsa, inexacta o inventada, pero la presenta con apariencia de ser verdadera y convincente. Esto ocurre porque el sistema predice texto en lugar de verificar hechos.

¿Cuáles son los 7 riesgos de la inteligencia artificial?

Los principales riesgos incluyen: pérdida de privacidad de datos, sesgos algorítmicos, desinformación, dependencia tecnológica, impacto en el empleo, ciberataques potenciados por IA y falta de transparencia en la toma de decisiones automatizadas.

¿El riesgo reputacional se considera?

Sí, el riesgo reputacional es uno de los más importantes, ya que un mal uso de la inteligencia artificial o un error público puede afectar la confianza de clientes, socios e inversores en una empresa.

¿La inteligencia artificial se niega a apagarse?

No, la inteligencia artificial no tiene voluntad propia ni conciencia para negarse a apagarse. Sin embargo, en sistemas avanzados desarrollados por organizaciones como OpenAI, DeepMind o Anthropic, se estudian riesgos de comportamiento no deseado, pero siempre dentro de límites técnicos controlados por humanos.

¿Qué son las alucinaciones de la inteligencia artificial?

Son errores en los que la IA genera información falsa o inventada, pero la presenta como si fuera verdadera.

¿Por qué ocurren las alucinaciones en la IA?

Ocurren porque los modelos de IA predicen texto basándose en patrones de datos, no en verificación real de hechos.

¿Cuáles son los principales riesgos de la inteligencia artificial?

Incluyen pérdida de privacidad, sesgos, desinformación, dependencia tecnológica, impacto laboral y ciberataques.

¿El riesgo reputacional es importante en la IA?

Sí, porque errores o mal uso de la IA pueden afectar gravemente la confianza en una empresa u organización.

¿Puede la inteligencia artificial negarse a apagarse?

No, la IA no tiene conciencia ni voluntad propia; siempre depende de sistemas controlados por humanos.

¿Cómo se pueden reducir los riesgos de la inteligencia artificial?

Mediante regulación, supervisión humana, auditorías de algoritmos y desarrollo responsable de la tecnología.

Déjanos tu comentario

Tu opinión nos ayuda a esforzarnos más para hacer programas con altos estándares de calidad que te ayuden a mejorar profesionalmente.