El riesgo de delegar la verdad al algoritmo

Los algoritmos de IA, particularmente los modelos generativos, no poseen una comprensión profunda de la realidad. Estos modelos operan a partir de patrones y correlaciones que extraen de los datos con los que son entrenados, pero no tienen la capacidad de validar la veracidad de la información de manera independiente. Un algoritmo puede generar una respuesta aparentemente válida basada en los datos disponibles, pero sin un entendimiento profundo de los hechos. Esta desconexión entre la inteligencia artificial y la verdad objetiva crea un riesgo significativo cuando la IA es responsable de la generación de contenido, recomendaciones o decisiones críticas.

Un ejemplo claro de este riesgo se da en los sistemas de IA que generan contenido escrito, como los que producen textos informativos o reportes automatizados. Estos modelos pueden combinar datos de diversas fuentes para crear textos convincentes, pero a menudo, el modelo no tiene la capacidad de discernir entre información veraz y errónea. Por ejemplo, si un modelo de IA es alimentado con información incorrecta o sesgada, podría producir un artículo con afirmaciones falsas o desinformación, presentándolas como hechos verificados. Lo más alarmante es que este tipo de contenido generado por IA puede pasar desapercibido si no se somete a un proceso de revisión humana, especialmente cuando el modelo produce respuestas con un alto nivel de coherencia y fluidez.

Es crucial entender que la IA es tan buena como los datos con los que se alimenta. Si estos datos están sesgados o contienen errores, el modelo generará resultados igualmente sesgados o erróneos. Por lo tanto, el riesgo de delegar la verdad al algoritmo no solo radica en la posibilidad de error, sino también en la falta de capacidad de la IA para reconocer los matices éticos y contextuales que son fundamentales en muchas situaciones.

Estrategias de supervisión humana en la empresa

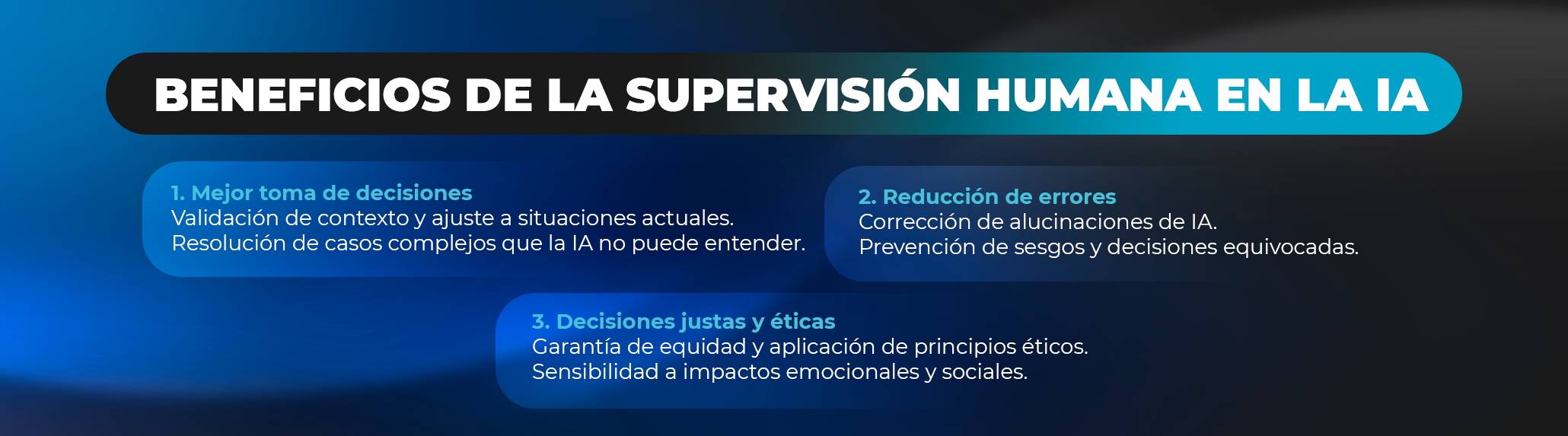

La integración de la inteligencia artificial (IA) en los procesos empresariales ha traído consigo mejoras significativas en eficiencia, productividad y capacidad de toma de decisiones. Sin embargo, debido a los riesgos inherentes de las "alucinaciones de IA" y las limitaciones de los modelos generativos, es fundamental implementar estrategias robustas de supervisión humana para garantizar que las decisiones automatizadas sean precisas, éticas y alineadas con los objetivos empresariales. Existen varias maneras de integrar la supervisión humana en el flujo de trabajo con IA:

-

Validación de resultados: Es fundamental que los resultados generados por IA sean verificados y validados por expertos humanos antes de su implementación o difusión. Esto puede incluir la revisión de informes, respuestas generadas por IA o cualquier otra salida relevante.

-

Control de calidad constante: La calidad de los modelos de IA debe ser monitoreada de forma continua. A medida que la IA aprende y se adapta a nuevos datos, es esencial evaluar regularmente su rendimiento y asegurarse de que no se generen alucinaciones. El control de calidad también incluye pruebas de los datos de entrenamiento para detectar cualquier sesgo que pueda influir en los resultados.

-

Integración de supervisores humanos: Los líderes deben integrar equipos de supervisores humanos que trabajen en conjunto con los sistemas de IA, asegurando que las decisiones generadas por las máquinas sean analizadas y aprobadas antes de ser ejecutadas. Estos supervisores deben tener la capacidad de cuestionar y desafiar las respuestas generadas por la IA cuando lo consideren necesario.

Ética y responsabilidad en el uso de IA

La ética en el uso de IA es un tema crucial, ya que, al depender de algoritmos para tomar decisiones, las empresas deben garantizar que esas decisiones no solo sean precisas, sino también justas, transparentes y responsables. A medida que la IA se integra en más aspectos de la vida cotidiana los líderes empresariales deben implementar políticas que guíen el uso de la IA de manera ética. Un líder debe:

-

Fomentar la transparencia: Las organizaciones deben ser transparentes con respecto al uso de la IA, explicando cómo se entrenan los modelos, de dónde provienen los datos y cómo se utilizan los resultados generados por las máquinas. La transparencia ayuda a mitigar el riesgo de desinformación y permite a los usuarios comprender cómo se toman las decisiones.

-

Promover la educación ética: Los líderes deben formar a su equipo no solo en el uso de herramientas de IA, sino también en los principios éticos que deben guiar su implementación. Esto incluye enseñarles a reconocer los riesgos potenciales, como las alucinaciones de IA, y cómo actuar de manera ética ante estos desafíos.

- Establecer políticas de rendición de cuentas: Es crucial que las organizaciones establezcan políticas claras sobre quién es responsable de las decisiones tomadas por IA. Si un modelo genera una alucinación que tiene consecuencias negativas, es necesario identificar la fuente del problema y asignar responsabilidades para evitar que se repita.

Preguntas frecuentes

¿Qué son las alucinaciones en un modelo de IA y por qué ocurren?

Las alucinaciones en un modelo de inteligencia artificial se refieren a situaciones en las que el sistema genera información incorrecta, inventada o sin base real, aunque la presente con seguridad. Esto puede incluir datos falsos, citas inexistentes o explicaciones que parecen coherentes pero no son verdaderas.

¿Cómo se producen las alucinaciones en la inteligencia artificial?

Las alucinaciones aparecen porque los modelos de IA, como los basados en aprendizaje automático, no “entienden” la realidad como los humanos. En su lugar, predicen texto basándose en patrones aprendidos de grandes cantidades de datos, lo que a veces puede llevar a combinaciones incorrectas o inventadas.

¿Qué significa exactamente una alucinación de IA?

Una alucinación de IA es un error en el que el sistema genera contenido que suena plausible, pero no está respaldado por datos reales o verificables. No es una mentira intencional, sino una limitación del propio modelo al generar respuestas.

¿Por qué las alucinaciones pueden parecer creíbles?

Las respuestas generadas por IA suelen estar bien estructuradas y redactadas con fluidez, lo que hace que incluso la información incorrecta parezca confiable. Esta apariencia de coherencia es lo que las hace especialmente engañosas.

¿Qué riesgos tienen las alucinaciones en la inteligencia artificial?

El principal riesgo es la difusión de información falsa, especialmente en ámbitos sensibles como la salud, la educación o las finanzas. Esto puede llevar a decisiones erróneas si el usuario no verifica las respuestas.

¿Cómo afectan las alucinaciones a la confianza en la IA?

Cuando los usuarios encuentran respuestas incorrectas, puede disminuir la confianza en estos sistemas. Por eso es importante entender que la IA es una herramienta de apoyo, no una fuente infalible de verdad.

¿Se pueden evitar completamente las alucinaciones de IA?

No se pueden eliminar al 100%, pero sí reducir. Los desarrolladores trabajan en mejorar los modelos con mejores datos, técnicas de verificación y sistemas de aprendizaje más avanzados.

¿Qué papel juega el entrenamiento del modelo en este problema?

El entrenamiento es clave, ya que la calidad y diversidad de los datos influyen directamente en la precisión de las respuestas. Datos incompletos o sesgados pueden aumentar la probabilidad de errores.

¿Cómo puede el usuario identificar una alucinación de IA?

Normalmente se detecta cuando la información no coincide con fuentes fiables o parece demasiado específica sin respaldo. Verificar con otras fuentes es la mejor forma de confirmarlo.

¿Qué se está haciendo para reducir las alucinaciones en IA?

Se están desarrollando técnicas como el uso de bases de datos verificadas, modelos híbridos con búsqueda en tiempo real y sistemas de validación automática para mejorar la precisión de las respuestas.

Déjanos tu comentario

Tu opinión nos ayuda a esforzarnos más para hacer programas con altos estándares de calidad que te ayuden a mejorar profesionalmente.